안전 AI 약속한 국내 대표기업들…자율규제 서약 공유

과기부 'AI신뢰‧안전성 콘퍼런스'…AI서울기업서약 6개사 참석

- 윤주영 기자

(서울=뉴스1) 윤주영 기자 = 안전한 인공지능(AI) 서비스를 약속한 국내 기업이 모여 자율규제 현황을 공유했다. 이들은 대형언어모델(LLM) 등의 취약성·위험을 스스로 식별·평가하는 한편 조만간 출범할 'AI 안전연구소' 등 공공의 평가도 반영하겠다고 약속했다.

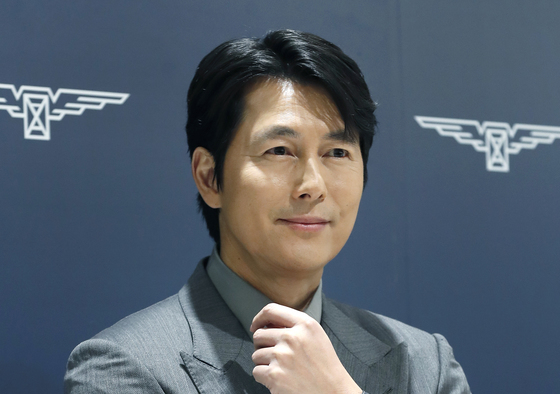

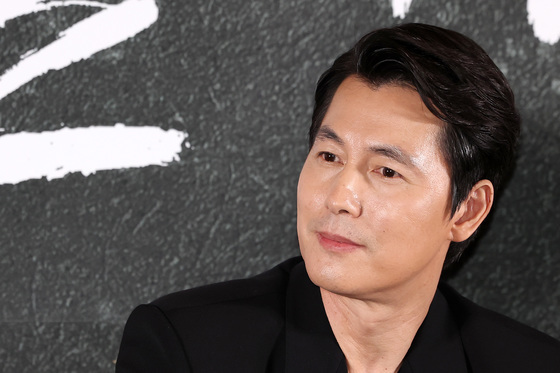

26일 오전 서울 용산구 전쟁기념관서 과학기술정보통신부가 개최한 'AI신뢰‧안전성 콘퍼런스'엔 삼성전자(005930), 네이버(035420), 카카오(035720), SK텔레콤(017670), KT(030200), LG AI연구원 등이 참석해 이를 논의했다.

이들은 앞서 5월 구글, 마이크로소프트(MS), IBM 등 해외기업 8곳과 함께 'AI서울기업서약'을 통해 AI 모델 위험성·안전사고를 모니터링·대응하는 내부 거버넌스 및 위험관리 정책을 마련하겠다고 약속했다.

이후 △네이버 'AI 세이프티 프레임워크'(ASF) △카카오 'AI 위험관리체계' △삼성전자 '온디바이스(기기 자체 탑재) AI에 대한 신뢰‧안전성 수립 및 운영' △SKT 'AI 행동규범' △KT '책임있는(Responsible) AI프레임워크' △LG AI연구원 AI윤리영향평가(이전 프로젝트 적용) 등이 꾸려졌다.

이날 현장서도 6개 사는 이와 함께 안전 AI에 필요한 위험 관리 방안, 기술 연구 등을 공유하는 한편 향후 노력을 강화하겠다고 약속했다.

또 AI분야 대기업‧스타트업, 연구자 등 200여명이 모여 AI 신뢰‧안전 기술‧정책을 공유했다.

요슈아 벤지오 몬트리올대 교수는 최첨단 AI 모델의 위험을 효과적으로 관리하려면 국내법과 국제 협약 간 상호 조화가 필요하다고 제시했다. 오혜연 한국과학기술원(KAIST) AI연구원장은 언어‧문화적 포용성, 격차 문제 등 AI의 글로벌 영향을 소개하며 AI 안전 분야서의 신시장 창출이 가능하다고 강조했다.

AI 신뢰‧안전성 확보에 필요한 기술, 평가기법, 데이터셋 구축 등 다양한 연구도 소개됐다. 박규병 튜닙 대표는 'AI안전장치(가드레일) 설루션을 활용한 다양한 형태의 위험탐지 및 대응방안'을 발표했다. 김동환 포티투마루 대표는 'AI신뢰성 인증(TTA) 획득 등을 통한 자사 LLM 신뢰‧안전성 확보사례'를 공유했다.

이 밖에도 올해 4월 국내 AI기업 4개 사(네이버·SKT·업스테이지·포티투마루)의 LLM이 지닌 잠재적 위험‧취약점을 발굴하는 '생성형 AI레드팀 챌린지' 결과도 소개됐다. 한국정보통신기술협회(TTA)는 참여자의 공격 시도 분석을 통해 잘못된 정보, 편견, 불법 콘텐츠 등 식별된 7가지 주요 위험과 공격기법을 공유했다.

과기정통부는 레드팀 챌린지 결과에 기반해 생성형 AI안전 프레임체계를 구축하는 한편 국내기업의 모델 위험 사전 평가를 지원할 계획이다.

이 밖에도 신뢰성 있는 AI 제품·서비스를 홍보하는 '제2회 AI신뢰성 대상' 시상식이 진행됐다. 위성, 영상 이미지의 공간정보를 분석하는 '다비오 어스아이2.0'(다비오 개발)이 대상을 받았다.

legomaster@news1.kr

Copyright ⓒ 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용금지.