"AI 위험성·한계 극복" 중심지…'AI안전연구소' 판교에 둥지

초대 소장 김명주 교수 "기업 규제 아닌 협력기관 될 것"

- 윤주영 기자

(서울=뉴스1) 윤주영 기자 = 인공지능(AI)의 기술적 한계, 인간의 기술 오용, AI 통제력 상실 등 다양한 AI 위험에 대응하는 안전연구 전담조직 'AI 안전연구소'가 출범했다. 연구소는 글로벌 AI 3대 거버넌스(안전·혁신·포용)를 실현하는 한편 AI 안전 글로벌 네트워크에 한국 대표기관으로서 참여할 예정이다.

과학기술정보통신부는 경기 성남시 판교 글로벌 연구개발(R&D)센터에서 AI안전연구소 개소식을 27일 진행했다.

올해 5월 'AI서울정상회의'에서 10개국 정상은 AI 혁신에 안전도 필수적이라는 것을 확인했으며, 윤석열 대통령은 글로벌 AI 안전성 강화 네트워크에 동참하겠다고 밝혔다. 그 일환으로 과기정통부는연구소를 출범하게 됐다.

연구소는 산·학·연 기관이 AI 안전 연구에 협력하고 정보를 교류할 수 있도록 허브로서 기능한다. 또 10개국이 참여하는 '국제 AI안전연구소 네트워크'의 일원으로서 안전 AI를 도모하는 글로벌 연대에 참가한다. 이를 통해 AI 안전 분야 기술·인력을 육성하는 한편 과학적 데이터에 근거해 정책의 개발·선진화를 추진한다.

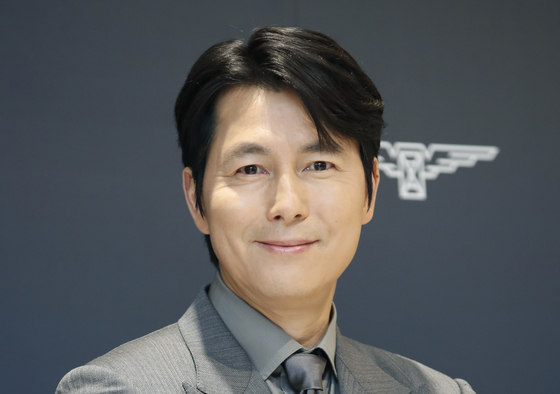

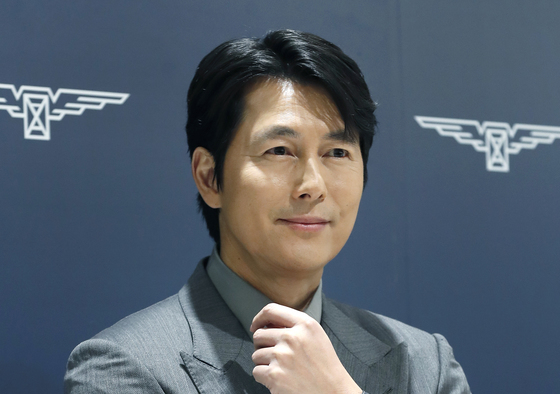

연구소 초대소장으로 임명된 김명주 서울여대 정보보호학부 교수는 "AI 활용으로 발생할 수 있는 제반위험 평가와 이를 예방·극소화하는 정책·기술을 개발·보급하고, 국내·외 연대를 강화하겠다"고 비전을 설명했다.

이어 "연구소는 규제 기관이 아니라 국내 기업이 글로벌 경쟁력을 확보하는 데 장애가 없도록 하는 협력기관이 될 것"이라고 강조했다.

국가AI위원회 글로벌 자문위원을 맡은 AI 석학 요슈아 벤지오 교수는 "연구소는 업계와 협업해 위험 평가방법을 연구·발전시키는 한편 안전성 요건을 수립하도록 지원해 줘야 한다"며 "국제 협력을 통한 AI 안전 체계의 상호 조화도 중요하다"고 덧붙였다.

엘리자베스 켈리 미국 AI안전연구소 소장은 "한·미 AI안전연구소가 전 세계와 함께 AI 위험을 줄이고 혜택을 극대화해 혁신을 촉진하도록 공통된 과학적 기준을 구축해야 한다"고 제시했다.

이어진 '대한민국 AI 안전 컨소시엄' 협약식에는 AI분야 국내 대표 산·학·연 기관 총 24곳이 참여해 AI 안전 정책연구, 평가, R&D에서 상호 협력한다는 내용의 업무협약(MOU)을 맺었다. AI안전연구소와 컨소시엄 참여기관은 AI 안전 프레임워크(위험 식별·평가·완화) 연구·개발·실증, AI 안전 관련 국제규범 대응 등 정책연구, AI 안전 관련 기술 협력 등을 중점적으로 추진할 계획이다.

이 밖에도 개소식에는 류광준 과기정통부 과기혁신본부장, 염재호 국가AI위원회 부위원장, 이경우 대통령실 AI·디지털 비서관 등 정부 주요 인사와 오승필 KT(030200) 최고기술책임자(CTO), 오혜연 한국과학기술원(KAIST) AI연구원장, 이은주 서울대 AI신뢰성 연구센터장, 방승찬 한국전자통신연구원(ETRI) 원장 등 산·학·연 핵심관계자 40여명이 참석했다.

legomaster@news1.kr

Copyright ⓒ 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용금지.